Il test di usabilità è il metodo di ricerca utente più diretto e potente: osservi un utente reale interagire con il tuo prodotto e misuri se riesce a completare i task, dove si blocca, e quali frustrazioni incontra. Da Nielsen anni '90 a oggi, è il gold standard della UX research applicata.

Questo articolo è una guida pillar ai test di usabilità: i tipi principali (moderato vs non-moderato, lab vs remoto, qualitativo vs quantitativo), quanti partecipanti servono davvero (con riferimento ai dati Nielsen), i costi reali nel 2026, i tool più usati, gli errori più comuni e quando NON fare un test di usabilità. Sotto, link a guide più specifiche per ogni metodologia.

Cos'è un test di usabilità

Un test di usabilità è una sessione strutturata in cui:

- Un partecipante target usa il prodotto (o prototipo)

- Un moderatore (opzionale) gli assegna task specifici

- Un osservatore raccoglie dati: completamento task, tempo, errori, commenti pensati ad alta voce

L'output è una serie di insights actionable: cosa funziona, cosa non funziona, quali sono i problemi prioritari da risolvere.

I 4 tipi principali di test di usabilità

1. Test moderato in lab o remoto

Un moderatore guida la sessione, fa domande di approfondimento, gestisce i task. È il formato più ricco di insight ma più costoso. 5-8 sessioni di 60 minuti = 1-2 settimane di lavoro.

Quando usarlo: per problemi complessi, prototipi early stage, decisioni strategiche di design.

2. Test non-moderato (asincrono)

L'utente esegue i task da solo, su tool come Maze, Lyssna o UserTesting. Il sistema registra schermo + voce. Più veloce ma meno profondo.

Quando usarlo: per validazione di prototipi maturi, screening rapido di flussi, A/B test di alternative.

3. Test guerriglia

Test informali in caffè, biblioteche, eventi. 10-15 minuti, partecipanti recruited on the spot. Costo zero, qualità variabile.

Quando usarlo: per sanity check rapidi, primi cicli di iterazione, validazione di idee in fase di brainstorming.

4. AB test (split test)

Confronti due varianti del prodotto su utenti reali in produzione, misuri quale converte meglio. È quantitativo, non qualitativo: ti dice "quale vince" ma non "perché".

Quando usarlo: per ottimizzazione continua di flussi già definiti, decisioni puntuali (testo del bottone, posizione del CTA), validazione di ipotesi quantitative.

Quanti utenti servono

La domanda più ricorrente. Risposta breve: 5 utenti per test moderato qualitativo, secondo lo studio classico di Nielsen del 2000.

La logica matematica: con 5 utenti scopri ~85% dei problemi di usabilità. Aggiungere il 6°-10° utente trova sempre meno problemi nuovi (curva con rendimenti decrescenti). Investi in più rounds di 5 utenti, non in un singolo round di 15.

Eccezioni:

- Test quantitativi (AB test, statistiche significatività): minimo 100-500 utenti per variante

- Più segmenti utenti: 5 per segmento, non 5 totali. Se hai 3 segmenti = 15 utenti

- Test su prodotti maturi: 8-10 utenti perché i problemi residui sono sottili

Costi reali nel 2026

Range di costi per un round di test moderato remoto (5 partecipanti):

- DIY (interno): €0-500 (recruiting via email lista, moderatore interno, Zoom)

- Mid-tier: €1.500-3.000 (recruiting agency, moderatore senior, tool dedicati)

- Premium: €5.000-15.000 (lab fisico, recruiting specialistico, full report con video)

Per non-moderato (Maze, Lyssna, UserTesting):

- Self-recruited: €100-500 totali (incentivi €20-50 per partecipante)

- Recruiting integrato: €30-80 per partecipante (panel del tool)

I 6 tool più usati nel 2026

- Maze: il più amato per non-moderato su prototipi Figma. Ottimo per AB test di flussi.

- Lyssna (ex UsabilityHub): test non-moderati, 5-second test, preference test.

- UserTesting: panel grande, costoso, premium per ricerca scale.

- Lookback: moderato remoto, ottima registrazione delle sessioni.

- Hotjar / Microsoft Clarity: heatmap e session recordings on real users.

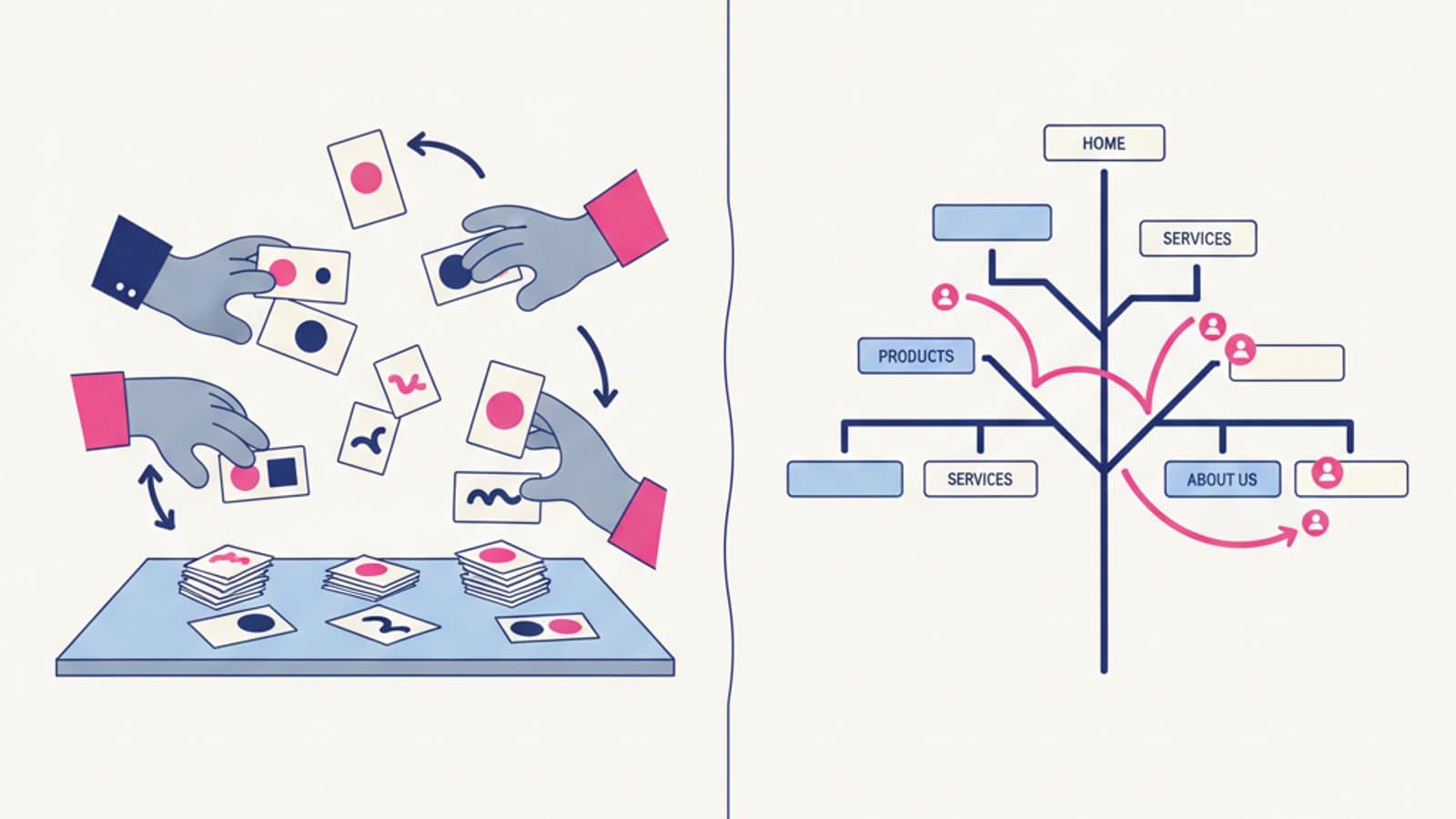

- Optimal Workshop: card sorting + tree testing + 5-second test (vedi guida).

Le 6 best practice essenziali

1. Scrivi i task come scenari, non come istruzioni. Bad: "Clicca sul bottone di registrazione". Good: "Stai cercando un corso UX online. Sei sul nostro sito. Cerca di iscriverti al corso che ti sembra più adatto".

2. Usa il pensa-ad-alta-voce (think aloud). Chiedi all'utente di verbalizzare quello che pensa mentre esegue il task. È l'oro della ricerca qualitativa.

3. Non aiutare durante il task. Se l'utente si blocca, lascialo bloccato e osserva. L'aiuto contamina il dato.

4. Misura sia successo sia tempo. "Ha completato il task" + "in quanto tempo" + "con quanti errori" ti danno tre dimensioni del problema.

5. Testa prototipi, non solo prodotti finiti. Più early è il test, più cheap è il fix. Testare in idea-stage costa 1, in production 100.

6. Itera in cicli rapidi. 1 round / settimana è meglio di 1 round / mese con 4 utenti.

I 5 errori comuni

1. Test su utenti sbagliati. Recruitare conoscenti o colleghi che NON sono il target invalida tutto.

2. Task troppo specifici (leading). "Trova il bottone X" suggerisce dove cercare. "Iscriviti al corso" lascia l'utente esplorare.

3. Confondere preferenza con usabilità. "Quale variante preferisci?" è una test di preferenza, non di usabilità. Sono cose diverse.

4. Non analizzare i risultati. Fare 5 test e non tradurre in fix è cargo cult.

5. Aspettarsi statistical significance da test qualitativi. 5 utenti non danno significatività, danno insight. Per significatività servono AB test.

Quando NON fare un test di usabilità

- Quando hai già 100 ticket di support che dicono cosa non va. Risolvi quelli prima.

- Quando il problema è strategico (prodotto giusto?) e non tattico (è ben fatto?). Serve Jobs to be Done, non test di usabilità.

- Quando il prodotto è in idea stage senza prototipo. Servono interviste utente prima.

- Quando hai meno di 1 settimana per il fix. I risultati arrivano troppo tardi.

Domande frequenti

Devo pagare i partecipanti?

Quasi sempre sì. Standard 2026 in Italia: €25-50 per sessione di 30-60 minuti. Senza incentivo monetario, recruitare è 5× più lento e i partecipanti sono meno rappresentativi.

Posso fare il moderatore da junior?

Sì, è una skill che si impara facendo. Inizia con 2-3 sessioni osservando un senior, poi modera tu con un senior che osserva. Dopo 5-10 sessioni autonome sei operativo.

Quanti task per sessione?

4-6 task per sessione di 60 minuti. Più di 8 e l'utente si stanca. Meno di 3 e non scopri abbastanza.

Test remoto è valido come in lab?

Per la maggior parte dei progetti sì. Il lab dà più segnali non-verbali (linguaggio del corpo, micro-espressioni) ma costa 5-10× di più. Per l'80% dei progetti, remoto è sufficiente e più rapido.

AB test sostituisce il test di usabilità?

No. Sono complementari. Test di usabilità trova problemi prima del lancio (qualitativo). AB test ottimizza dopo il lancio (quantitativo). Servono entrambi nel ciclo di vita del prodotto.

Prossimi passi

I test di usabilità sono il cuore del lavoro di un UX Researcher. Il Corso di User Research di CorsoUX include 9 capitoli con 62 lezioni che coprono interviste, test moderati e non-moderati, AB testing, analisi dati e sintesi insight. Mentor 1:1 corregge ogni esercizio. Prova le prime lezioni gratis.

Per approfondire metodologie specifiche: card sorting e tree testing, eye tracking, AB test guida pratica, tool per test non-moderati e test di preferenza.