Un copy può sembrare perfetto al designer che lo ha scritto, al copywriter che lo ha revisionato, al product manager che lo ha approvato — e risultare incomprensibile al 70% degli utenti reali. La differenza tra "sembra chiaro" e "è chiaro" non è un'opinione: si misura. I test dei contenuti sono i metodi per farlo, e nel 2026 sono parte del workflow di ogni team di prodotto serio.

Questo articolo copre 7 metodi pratici per testare i contenuti dell'interfaccia, ognuno con il suo sweet spot, i suoi costi e i suoi limiti. Capire quale scegliere in base alla domanda che stai cercando di rispondere fa la differenza tra una content strategy guidata dai dati e una guidata dalle opinioni.

Cosa imparerai leggendo:

- Perché testare i contenuti non è opzionale nel 2026

- I 7 metodi principali: quando e come usarli

- Come costruire un content testing workflow continuo

- Gli errori più comuni nel test dei contenuti

- Come integrare il content testing nel processo di design

Perché testare i contenuti

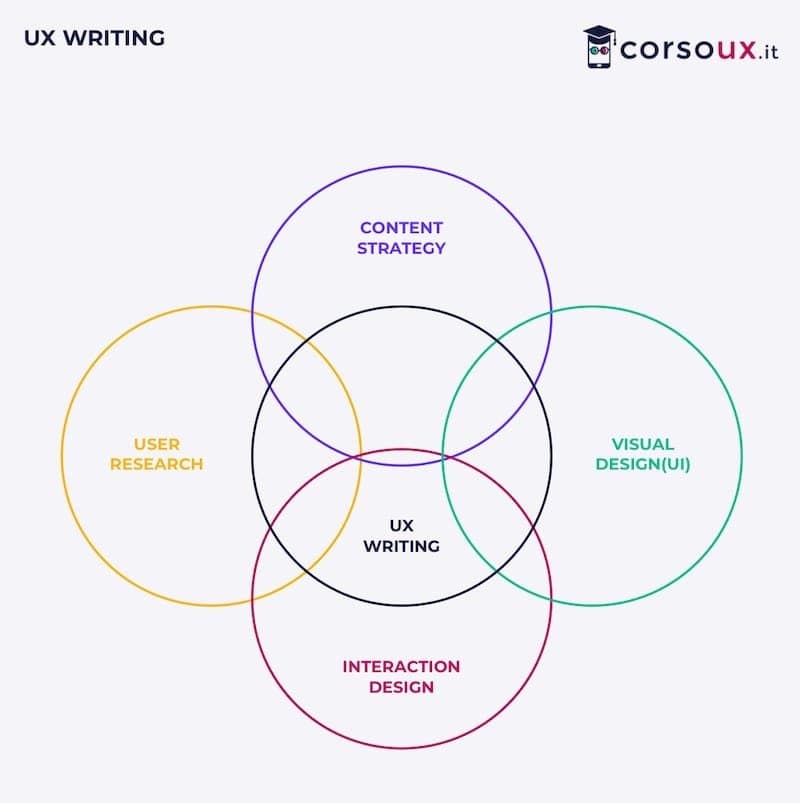

Tre ragioni concrete per cui il content testing è diventato una parte irrinunciabile del UX Writing e del UX Design maturi.

1. Il testo è la prima interazione

Prima ancora di cliccare un bottone, l'utente legge qualcosa. Il testo precede quasi ogni azione: labels, CTA, error messages, conferme. Se il testo è sbagliato, tutto il resto del design non funziona.

2. Le opinioni interne sono sistematicamente sbagliate

Chi lavora ogni giorno su un prodotto è immerso nel suo vocabolario, nelle sue logiche interne, nelle sue convenzioni. Perde la prospettiva dell'utente nuovo. Un team interno che "valuta" il proprio copy è sistematicamente meno critico di un test con utenti reali — di solito del 30-50%.

3. Il costo di riparare è alto

Un copy sbagliato scoperto dopo il lancio costa 10-100 volte di più di uno scoperto in fase di design. Richiede aggiornamenti di rilasci, comunicazioni, eventuali customer support. Testare prima è molto più economico.

I 7 metodi di content testing

1. Cloze Test

Cos'è: un test di comprensibilità dove rimuovi ogni 5a parola da un testo e chiedi agli utenti di riempire i buchi. La percentuale di risposte corrette misura quanto il testo è "predicibile" e quindi comprensibile.

Quando usarlo: per valutare la comprensibilità generale di un testo lungo (onboarding, help text, policy).

Limiti: non misura il significato globale, solo la capacità di inferire parole mancanti. Vedi la guida completa al cloze test.

2. Highlight Test (evidenziazione)

Cos'è: mostri un testo agli utenti e chiedi loro di evidenziare (con colori diversi) le parti che li rassicurano e quelle che li confondono o li mettono in dubbio.

Come si fa:

- Prendi un copy di onboarding, policy, o descrizione prodotto

- Chiedi a 10-15 utenti del target di leggerlo

- Dagli due colori: verde per "chiaro e rassicurante", rosso per "confuso o dubbioso"

- Analizza i pattern: quali parole o frasi ottengono più rosso?

Quando usarlo: per testi che devono rassicurare o persuadere — checkout flow, richieste di dati sensibili, policy legali.

Punti di forza: emerge subito dove il testo "perde" l'utente emotivamente.

3. Comprehension Test

Cos'è: mostri un testo all'utente, poi gli poni 3-5 domande di comprensione ("Cosa devi fare dopo aver letto questo?", "Quale di queste opzioni è corretta?"). Misuri la percentuale di risposte corrette.

Quando usarlo: per contenuti guidati (tutorial, istruzioni, policy) dove è importante che l'utente comprenda accuratamente il messaggio.

Come valutare: sopra l'80% di risposte corrette su 30+ partecipanti = comprensibile. Sotto il 60% = da riscrivere.

4. Five-Second Test (per copy visibile)

Cos'è: mostri all'utente una schermata per esattamente 5 secondi, poi la fai sparire e chiedi "Cosa hai visto? Cosa ricordi? Cosa pensi che faccia questo prodotto?".

Quando usarlo: per homepage, landing page, pagine con headline e sub-headline primarie. Il test verifica se il messaggio chiave arriva nei primi 5 secondi di attenzione dell'utente.

Tool: Lyssna (ex UsabilityHub) ha un template five-second test dedicato.

5. Preference Test su varianti di copy

Cos'è: mostri due o tre varianti dello stesso copy e chiedi agli utenti quale preferiscono e perché. È un test di preferenza classico applicato al linguaggio.

Quando usarlo: quando stai scegliendo tra alternative stilistiche (tono formale vs informale, frase lunga vs breve, benefit vs feature nel titolo).

Limiti: misura l'opinione dichiarata, non il comportamento reale. Per decisioni importanti, combinalo con un A/B test comportamentale (vedi punto 7). Per approfondire leggi la guida al test di preferenza.

6. Usability Test Task-based

Cos'è: dai all'utente un task concreto ("cerca di cambiare la tua password") e osservi se ci riesce usando l'interfaccia. Il test include automaticamente il test del copy, perché l'utente deve leggere per capire dove andare.

Quando usarlo: per validare flussi interi dove il copy è parte del sistema di wayfinding. È il metodo più completo ma anche il più costoso.

Limiti: è lento (5-8 sessioni da 45 minuti) e richiede moderazione. Ma è l'unico che misura davvero il comportamento dell'utente in relazione al copy.

7. A/B Test Comportamentale

Cos'è: in un prodotto live, fai vedere versione A del copy al 50% degli utenti e versione B all'altro 50%. Misuri conversioni, completamenti, click-through. La variante che performa meglio vince.

Quando usarlo: per decisioni importanti su prodotti con traffico sufficiente. Sei sicuro al 95% quale copy produce migliori risultati comportamentali reali.

Limiti: richiede volumi significativi (migliaia di esposizioni per variante), serve infrastruttura di testing, richiede settimane per risultati statisticamente solidi. Per il dettaglio leggi la guida all'A/B test.

Come scegliere il metodo giusto

Tre domande per decidere:

In che fase del design è il tuo copy?

- Fase esplorativa (prime bozze): five-second test, highlight test

- Fase di convergenza (varianti decise): cloze test, comprehension test, preference test

- Fase di validazione finale (prima del lancio): usability test, A/B test

Quanto è importante la decisione?

- Piccola (un tooltip, una label): preference test rapido con 10 persone

- Media (titolo di pagina, CTA principale): cloze test o comprehension test con 30-50 persone

- Grande (intero onboarding, checkout, policy): usability test + A/B test successivo

Quali risorse hai?

- Poche (tempo e budget limitati): highlight test o preference test con il tuo network

- Medie: cloze test o comprehension test con panel

- Ampie: usability test completo + A/B test comportamentale

Costruire un content testing workflow

I team maturi integrano il testing dei contenuti in un workflow continuo, non come eventi una tantum. Un ciclo tipico:

- Content draft: il writer scrive la prima versione

- Internal review: il team (designer, PM, ingegneri) dà feedback

- Quick test (obbligatorio prima del rilascio): preference test o five-second test con 10-15 persone

- Implementation: il copy finisce nel prodotto

- Monitoring: si osservano le metriche comportamentali (conversion, abandon, support tickets)

- Iteration: se i dati suggeriscono problemi, torna al punto 1

Questo ciclo non aggiunge settimane al processo — aggiunge ore, a fronte di decisioni molto più solide.

Errori comuni nel content testing

1. Testare solo dopo il rilascio

"Lanciamo e poi vediamo i dati" è una strategia legittima per ipotesi piccole, ma per copy critici (onboarding, checkout) è tardi: il costo di correggere è molto più alto del costo di testare prima.

2. Campioni troppo piccoli

Un test su 5 persone ti dà indicazioni, non certezze. Per decisioni importanti serve un campione di 30-50 minimo.

3. Partecipanti fuori target

Testare un'app per anziani con ventenni è un errore classico che invalida completamente i risultati.

4. Ignorare l'analisi qualitativa

I numeri del test sono solo metà della storia. Le ragioni che i partecipanti danno sono altrettanto preziose, spesso di più. Non limitarti a contare, leggi e raggruppa per temi.

5. Non iterare

Fai un test, trovi problemi, ma poi non implementi i cambiamenti "per mancanza di tempo". Il test è inutile se non produce modifiche reali al copy.

Domande frequenti

Devo testare ogni singolo copy del mio prodotto?

No. Testa i copy critici (onboarding, checkout, errori di sistema importanti, policy) e quelli ad alto impatto (CTA principali, titoli di landing). Il resto può essere scritto con best practice e rivisto ex post.

Quanto costa fare content testing?

Varia enormemente. Un preference test rapido con Lyssna costa 50-150 €. Un usability test completo con panel esterno 1.500-3.500 €. Un A/B test comportamentale richiede infrastruttura (300-800 €/mese per tool) ma zero costi per partecipante.

Il content testing vale anche per prodotti B2B?

Sì, forse ancora di più. I prodotti B2B usano tipicamente un linguaggio tecnico che può escludere utenti meno esperti, e gli effetti di cattivo copy (abbandoni, richieste di supporto) sono più costosi in contesti B2B.

Posso fare content testing senza un UX Writer dedicato?

Assolutamente sì. I metodi di questo articolo sono accessibili a chiunque — designer, product manager, content marketer. Il content testing non è una skill "specialistica" ma una pratica basilare.

Come combino content testing e visual design testing?

Nei test importanti combinali: il copy esiste in un contesto visivo. Un usability test completo verifica entrambi insieme. Per test rapidi focalizzati, puoi isolare il copy (cloze test, highlight test) o il visual (five-second test su layout senza testo definitivo).

Quali metriche monitoro dopo aver implementato un copy nuovo?

Dipende dal contesto. Per un CTA: click-through rate. Per un onboarding: completion rate del flow. Per un messaggio di errore: tasso di recupero dall'errore. Per un help text: riduzione dei ticket di supporto su quel tema. Sempre almeno una metrica misurabile collegata al copy.

Prossimi passi

Il content testing è la disciplina che separa l'UX Writing guidato dai dati da quello guidato dall'opinione. Per integrarlo nel tuo workflow:

- Leggi la guida completa al cloze test per il metodo più specifico

- Studia i principi di UX Writing che il testing aiuta a validare

- Approfondisci l'A/B test comportamentale per la validazione finale

Nel Corso di UX Writing di CorsoUX insegniamo tutti i metodi di content testing con esercitazioni pratiche, integrati nel workflow reale di scrittura per interfacce.